Рекомендуем активно использовать шифрование для защиты личных данных. Современные технологии обеспечивают удобство, но при этом ставят под угрозу приватность. Особенный интерес вызывает использование искусственного интеллекта, который может анализировать и обрабатывать огромные объёмы информации. Безопасность ваших данных перестает быть лишь вопросом личных настроек. Она зависит от общества в целом.

Развитие интеллекта ИИ активно меняет подходы к защите конфиденциальности. Надежные системы хранения данных больше не способны гарантировать защиту без соответствующих мер предосторожности на личном уровне. Эффективные методы, такие как многослойная аутентификация и регулярное обновление паролей, становятся необходимыми. Эти действия должны стать частью вашей повседневной практики.

Этика ИИ также является важным аспектом, который требует обсуждения. Пользователи должны осознавать, как их данные используются и кто имеет к ним доступ. Большие компании больше отвечают за обработку информации, однако ответственность за сохранение личной приватности остается на каждом из нас. Необходимо требовать прозрачности от сервисов, которые мы используем, чтобы защитить свою конфиденциальность в цифровом мире.

Как ИИ трансформирует подходы к защите персональных данных

Искусственный интеллект влияет на сохранение конфиденциальности данных, предлагая новые алгоритмы для обработки и защиты информации. Компании могут использовать технологии машинного обучения для анализа больших объемов данных и выявления потенциальных угроз безопасности. Эти инструменты помогают быстрее реагировать на утечки и недоступность данных, ведь конфиденциальность сегодня стала приоритетом.

С введением GDPR организации обязаны строго следить за обработкой персональных данных. ИИ предлагает решения для автоматизации процессов соответствия требованиям, включая мониторинг и отчетность. Такие технологии будущего облегчают задачи, связанные с обеспечением приватности, так как системы способны обнаруживать аномалии и нарушения в реальном времени.

Оптимизация подходов к защите данных с помощью искусственного интеллекта включает в себя использование анализа векторных пространств и обработки естественного языка. Это способствует более тонкому и контекстуальному пониманию, когда речь идет о конфиденциальности и безопасном хранении информации. Постоянное обновление алгоритмов позволяет поддерживать высокий уровень защиты.

В условиях современной эпохи технологии становятся мощным инструментом в борьбе за сохранение приватности. ИИ не только преобразует старые подходы, но и создаёт новые стандарты, требующие от организаций ответственности и прозрачности. Используя искусственный интеллект, предприятия могут принимать более обоснованные решения в области управления данными и защиты личной информации пользователей.

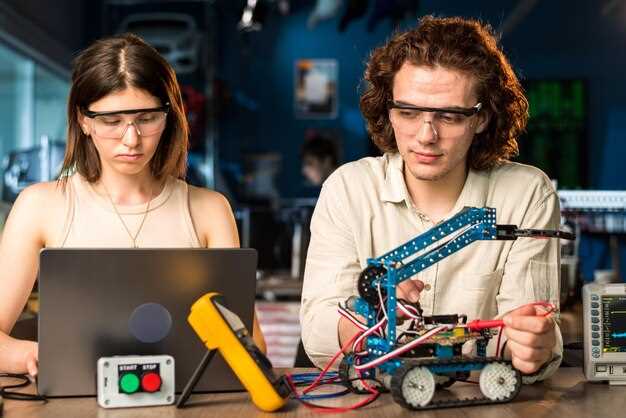

Методы сохранения конфиденциальности в использовании алгоритмов ИИ

Для обеспечения безопасности информации при использовании ИИ, сосредоточьтесь на анонимизации данных. Удаление или замена личной информации помогает минимизировать риски раскрытия личных данных. Используйте методы деидентификации, такие как маскировка и агрегация данных.

Соблюдение стандартов, таких как GDPR, помогает в защите личных данных. Рассмотрите внедрение принципа минимизации данных, при котором собираются только силы, необходимые для работы алгоритмов, без избыточной информации.

Шифрование данных – еще один надежный способ сохранить безопасность информации. Это защищает данные на всех этапах их обработки. Комбинируйте шифрование с безопасными протоколами передачи для защиты данных во время их перемещения.

Разработка алгоритмов с учетом приватности (Privacy by Design) позволяет заранее интегрировать механизмы защиты данных. Это включает создание моделей машинного обучения, которые обрабатывают данные таким образом, чтобы сохранение конфиденциальности было встроено в сам процесс обучения.

Регулярные аудиты безопасности также критически важны. Они помогают выявить уязвимости и проблемы, связанные с приватностью, позволяя предпринять необходимые меры по их устранению. Настройте системы оповещения для раннего выявления утечек или несанкционированного доступа к данным.

Использование фреймов, таких как federated learning, позволяет обучать модели без необходимости отправки личных данных на центральные серверы, что существенно снижает риски утечки информации.

Следуя этим рекомендациям, организации смогут эффективно справляться с вызовами приватности в эпоху искусственного интеллекта и обеспечивать защиту личных данных пользователей.

Правила и стандарты для защиты данных в системах ИИ

Компании должны чётко определять правила обработки данных в матчах с требованиями GDPR. Важно установить механизмы получения согласия пользователей на обработку их личной информации. Каждый пользователь должен быть полностью информирован о целях использования своих данных и сроках их хранения.

Значение безопасности информации повышается в эпоху ИИ. Все системы, использующие искусственный интеллект, должны включать в себя защитные механизмы, такие как шифрование и анонимизация, чтобы гарантировать конфиденциальность данных. Использование защищённых каналов передачи данных также играют ключевую роль.

Разработка стандартов для иерархии доступа к данным обеспечивает корпоративную безопасность и предотвращает несанкционированный доступ. Необходимы регулярные проверки и аудит на соответствие установленным правилам обработки данных.

Обучение сотрудников аспектам безопасности данных станет важным шагом в поддержании конфиденциальности. Правила должны включать информацию о возможных угрозах и предостережениях при работе с личной информацией пользователей.

Мониторинг и отчётность о действиях в системах ИИ помогут выявлять нарушения и минимизировать потенциальные риски. Актуальные протоколы реагирования на инциденты обеспечивают быструю реакцию на утечки данных, защищая личную информацию.